6 支持向量回归

支持向量回归的一般形式:

\min _{\mathrm{f}}\left[ \Omega(f)+C \sum_i^m \ell\left(f\left(x_i\right), y_i\right)\right]

其中:

- \Omega(f) 结构风险、正则化项:用于描述 f 的某些性质

- \sum_i^m \ell\left(f\left(x_i\right), y_i\right) 经验风险:用于描述模型与训练数据的契合程度

- C 正则化系数:用于对二者进行折中

L_p 范数是常用的正则化项:

- L_2 倾向于 w 分量取值尽量均衡,即非零分量个数尽量稠密

- L_{0/1} 倾向于 w 分量尽量稀疏,即非零分量个数尽量少

支持向量回归

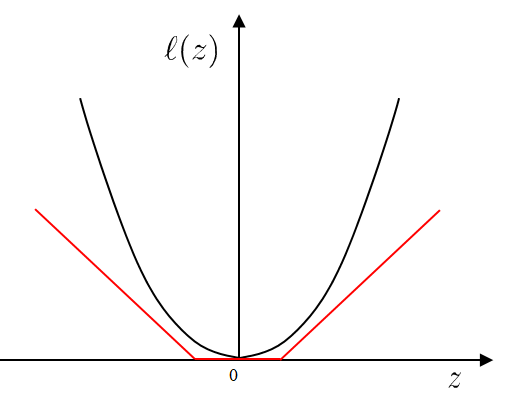

以前我们的回归模型要求 f(x)=y 时损失才为 0,但是支持向量回归(SVR)能够容忍最多 \epsilon 上下的偏差,也就是说 |f(x)-y|\le\epsilon 都视为预测正确。

落入中间 2ϵ 间隔带的样本不计算损失,从而使得模型获得稀疏性。新的损失函数(下方红线)为:

\ell_\epsilon(z)= \begin{cases}0 & \text { if }|z| \leq \epsilon \\ |z|-\epsilon & \text { otherwise }\end{cases}

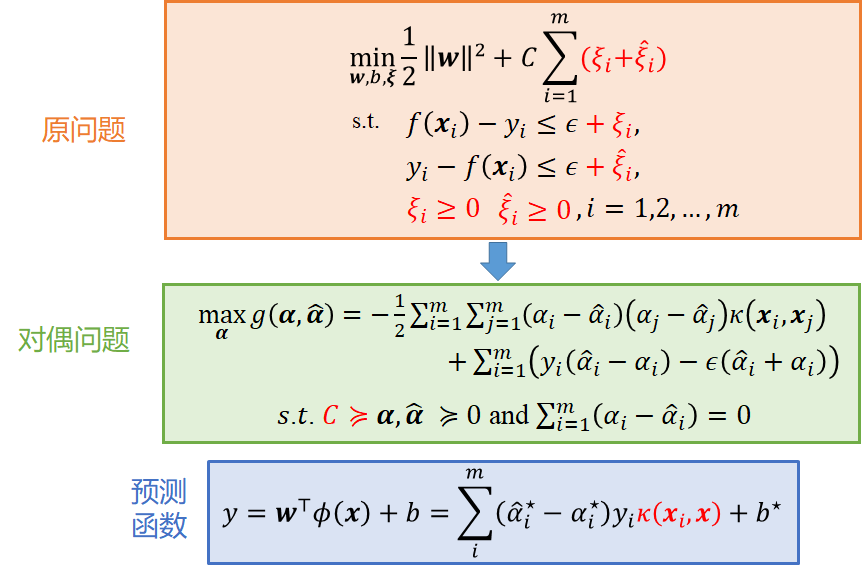

原来的优化目标变为

\min _{\boldsymbol{w}, b} \frac{1}{2}\|\boldsymbol{w}\|^2+C \sum_{i=1}^m \ell_\epsilon\left(f\left(\boldsymbol{x}_i\right)-y_i\right)

同样通过求解对偶问题,不细说。

这里 \xi_i+\hat\xi_i 的原因是,两侧的松弛程度可能不同。