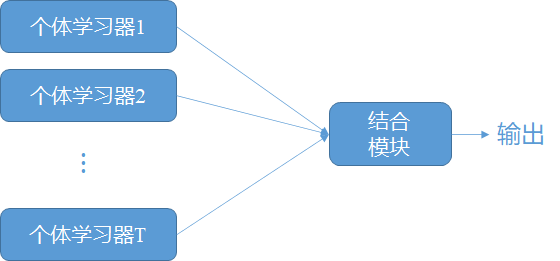

集成学习概述

集成学习获得比单一学习器显著优越的泛化性能,对弱学习器尤为明显。

设第 i 个分类器的预测结果是 h_i(x),真实标记是 f(x)

设第 i 个分类器的错误概率是 p(h_i(x)\neq f(x))=\epsilon

现在我们用简单投票法,所有分类器对 x 的预测结果是 H(x)=\text{sgn}[\sum h_i(x)],即最终结果是超过半数的投票结果

假设我们一共用 T 个个体分类器,其中对 x 预测正确的分类器数量是 n(T),则集成分类器预测错误表示预测正确的分类器没超过一半,即 $$ p(n(T)\le\lfloor T/2\rfloor)=\sum_{k=0}^{[T/2]}p(n(T)=k)=\sum_{k=0}^{[T/2]}C_T^k(1-\epsilon)^k\epsilon^{T-k} $$ 霍夫丁不等式给出了随机变量的和与其期望值偏差的概率上限,即 $$ p(\frac{n(T)}{T}\le E[\frac{n(T)}{T}]-\delta)\le \exp(-2\delta^2T) $$ 所以可以凑形式,做个估计:

令 E[n(T)]-\delta T=T/2,得 \delta=[En(T)-T/2]/T=E(n(T))/T-1/2,而 E(n(T))=T(1-\epsilon),所以 \delta=\frac12-\epsilon $$ \begin{aligned} p(n(T)\le [T/2])&\le p(n(T)\le T/2)\newline &\le \exp(-2(\frac12-\epsilon)^2T) \end{aligned} $$ 说明在一定条件下,随着集成分类器数目(T)的增加,集成的错误率将指数级下降,最终趋向于 0

上面的分析有一个关键假设:基学习器的误差相互独立

现实任务中,个体学习器是为解决同一个问题训练出来的,显然不可能互相独立!

事实上,个体学习器的 “准确性” 和 “多样性” 本身就存在冲突,如何产生 “好而不同” 的个体学习器是集成学习研究的核心。

集成学习分类

- 个体学习器之间存在强依赖关系,必须串行生成的序列化方法 —— Boosting

- •个体学习器不存在强依赖关系,可同时生成的并行化方法 —— Bagging 和随机森林